2022年11月30日,美国人工智能公司OpenAI正式发布大型自然语言交互程序聊天机器人ChatGPT(Chatbot Generative Pre-training Transformer)。随后,又推出GPT-3.5并很快迭代到GPT-4。这对于信息生产、流通全过程的改变,不仅掀开了人工智能被用于现实传播问题的序幕,也将助长国际体系与社会生活中根深蒂固的系统性偏见、有意欺诈、政治造谣、伪造身份等问题。这种强有力的变革对认知域作战同样会产生巨大影响,将会使得认知域作战的形式更加丰富、手段更加隐蔽、防范更加困难,其对于社会生活、政治生态和社会总体意识形态的影响也将会更加深入。需要深入分析其在认知域作战中的运用场景,把握认知规律、重塑认知内容、优化认知过程。

认知域作战视角下的ChatGPT主要特性

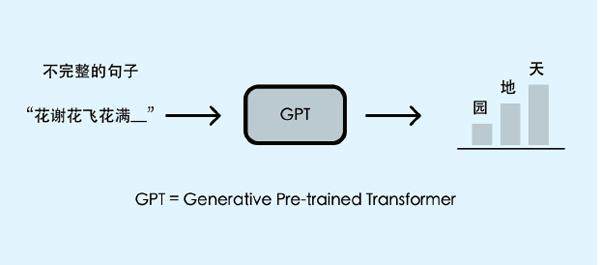

ChatGPT是在GPT(Generative Pre-trained Transformer)模型的基础上通过改进优化得到的,针对对话场景利用“人在回路”进行了优化。GPT是一种大型语言模型,是现阶段对于自然语言进行机器学习的主流思路,能够生成各种不同的文本类型。它可以根据上下文自动生成与人类语言类似的文本对话。GPT模型主要思路是让AI在通用的、海量的数据上学习文字接龙,即掌握基于前文内容生成后续文本的能力。目前GPT模型已经发展到了第四代,是针对对话场景进行针对性优化的结果。相比于以往的固定对话式人工智能,ChatGPT拥有自己的思考逻辑,因此在不处于“人在回路”的监管时,系统可以对同一问题给出多种回答,只不过这些回答在系统偏好的作用下以概率分布的形式存在。

ChatGPT作为新一代人工智能,在引入大数据进行自主学习时使用人工对系统学习结果进行评价,从某种意义上说,该过程正是赋予系统“灵魂”、完成画龙点睛的过程。但是由于人类本身固有的政治立场或倾向,使得在对学习结果进行筛选时,筛选结果不可避免地被打上了监督者的个人标签,从而在这一过程中给系统带入了一种“预设的价值观”,使其成为认知域作战的“新利器”。

一是难以抹去的价值底色。ChatGPT的价值观底色根植于参与该系统设计研发人员的价值观取向,即“硅谷价值观”,属于美国左派的温和派。这种底层逻辑的审视使得ChatGPT常常表現为美国精神的“卫道者”,在测试者的政治性话题中,ChatGPT对于涉美议题或涉及外国政治人物的话题上往往采取中立或避而不谈的态度,但是在关于美国正面话题的谈论上却表现得相对积极。除此之外,对于诸如少数族裔问题、枪支问题、堕胎问题、环保问题等争议性话题,ChatGPT也表现出相对保守的态度,并且在整体取向上更加偏向于温和左派。

在ChatGPT上线互联网后,世界各国的网民也都参与到了与ChatGPT的互动中来,并在大量的交流中逐渐发现ChatGPT在面对不同语言的提问时,同一问题往往会得到不同答案,并且这种改变是随着社会动态的变化而随时改变的。这种“见人下菜碟”的行为说明该智能系统仍处于成长学习阶段,且在该过程中系统所受到的人为干预远不止训练模型中标注出来的那么简单,这种实时且强有力的人为干预将ChatGPT的预设价值观推向了更加隐蔽、更加晦涩的深层次。

二是开放可塑的数据训练。ChatGPT本质上是基于GPT模型,针对聊天环境进行指向性优化的结果。GPT模型在面对不同来源的数据进行学习时,会根据数据本身“意义分布”的不同而学习得到不同的结果。这意味着,已经被ChatGPT证明相对成熟的GPT模型将可以在差异性数据来源的情况下,被培养成为适用于不同领域的特定人工智能。这种可塑性使得GPT系统的发展前景大大超过以往的自然语言学习系统,并且为GPT家族的发展壮大提供了可能性,也极大地拓宽了其市场前景与应用场景。