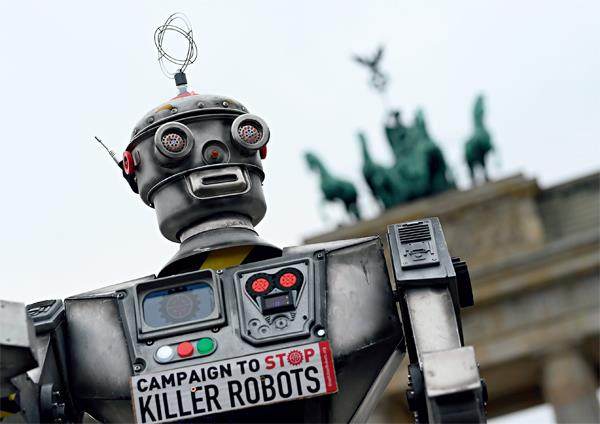

从武装机器狗到无人潜艇,再到搜寻目标的无人机,现代战争中越来越广泛应用的人工智能技术给人们带来了急需解答的伦理难题。

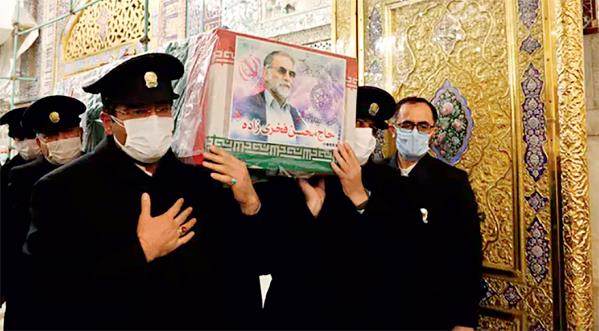

2020年11月27日,下午3点30分,一列车队驶入德黑兰的伊玛目霍梅尼大道。车内有一名重要人物——伊朗秘密核武器项目的总负责人穆赫辛·法克里扎德。当时,他与妻子正驾车前往乡村住宅,由安保车辆护送,然而在即将抵达目的地时遭到了袭击。

几声枪响过后,法克里扎德驾驶的黑色尼桑汽车被击中,无法继续行驶。枪声再次响起,子弹击中了这位科学家的肩膀,迫使他走出车辆求救。随后,完全暴露在外的他又遭受了致命一击,而坐在副驾驶的妻子安全无恙。

接下来,奇怪的事情发生了。一辆停在路边的皮卡车不知为何突然爆炸。事后,伊朗安全部队在检查皮卡车的残骸时,发现了一些机枪碎片。这是一把由电脑远程遥控的机枪,配备了多个摄像头。难道,法克里扎德是被机器人枪杀的?

《纽约时报》的后续报道披露,这把机枪并非全自动枪械。据推测,袭击者位于1000公里之外,会根据皮卡车回传的图片判断扣动扳机的时机,并利用人工智能软件解决信号延迟的问题。

这简直就是一场噩梦。互联网上流传的俄乌冲突的视频片段更是加深了人们的恐惧。在乌克兰战场上,无人机随处可见,从土耳其制造的“旗手”无人机、袭击船只的海上无人机,到能够投掷手榴弹的四轴飞行器。如果这些片段属实,那么现实情况只会越来越糟糕。

| 机器人的新风险 |

网上有这样一段视频:一架无人机将一只机器狗运送至目的地。机器狗落地后便迅速启动,背上还驮着一把机枪。在另一段视频中,一名俄罗斯人改装了一只商用机器狗,使其能够射出子弹。

针对这些触目惊心的视频,2022年10月,波士顿动力公司与另外五家机器人公司发表了联合声明:“我们认为,改装远程遥控机器人或自动化机器人,为它们添加武器,遥控它们进入从前难以进入的他人工作起居之地,这些会造成新的风险,也严重违反伦理。将此类新型机器人武器化,会导致公众不再信任本能造福社会的机器人技术。目前有大量个人尝试将商用机器人武器化的事件,我们表示强烈反对,并将极力避免这种情况。我们希望,有关部门能协助我们一同提倡安全使用移动机器人。