进入“电报”(以保密性著称的即时通信软件)聊天房,上传一张脸部照片,不到5秒钟,采用了深度伪造技术(Deepfake)的机器人(bot)就能合成一张真假难辨的照片——就当前而言,深度伪造技术已经可以把不同人的声音、面部及身体像拼图一样随意拼接,制作成各种影像乃至视频。

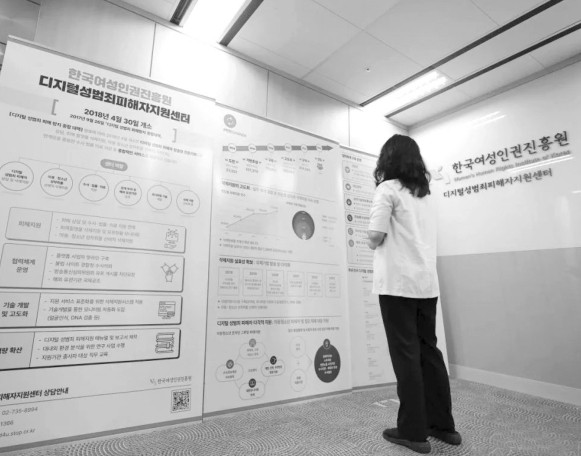

2024年8月,大量利用深度伪造制作色情合成物的“电报”聊天群在韩国的社交媒体上曝光,受害者遍布韩国全国,涉及明星、军人、老师、护士、学生等不同群体,多为女性。

但这并非韩国本土首次出现深度伪造性犯罪。2019年N号房事件被曝光时,曾有媒体报道过一些“电报”聊天房正利用合成技术制作色情影像。此后深度伪造性犯罪一度淡出公众视野,但并未真正消失。

在备受关注的“首尔大学深度伪造性犯罪”事件中,受害女性自己收集整理证据,用长达两年五个月的时间将加害者送上法庭。然而,有关深度伪造的数码性犯罪不仅没有得到遏制,反而愈演愈烈。

一出民间倒逼官方的奇观因此在社交媒体上演。从2024年8月末开始,韩国女性网友开始不断将受害者的经历翻译成不同的语言,在互联网上传播,几个深度伪造话题下的推文数量都超过了三万,一些热门推文的阅读量已突破一千万。

“正是由于韩国媒体的沉默,我们才不得不使用英语写作。这么做是为了迫使他们报道而非试图掩盖它。”参与者之一玛丽说。

“韩国的换脸问题太严重了。”“现在无法预测有多少女性因深度伪造技术而受害。”8月末,随着两位韩国女生在微博发文求助,“韩国新版N号房”等话题在中文互联网传播开来,并迅速占领热搜首位。

“韩国媒体和司法系统不会做他们应该做的事情,除非他们因为没有采取正确的行动而受到国际社会的抨击。”一位网友戏谑道。

合成一张裸照,只需三块四毛四

“发送一张你最喜欢的女孩的照片。”朴高恩进入房间后,立即收到聊天机器人发来的信息——这是“电报”上一个利用深度伪造非法合成色情影像的房间,参与者达22万人。

进入这些房间并不困难,只需要在社交媒体上搜索关键词便能收获一大串访问链接。

朴高恩按照提示放入一张由AI制作的虚拟女性照片,5秒后,一张裸体照被合成出来。她仔细端详照片,发现其足以以假乱真,照片一旁甚至还有按钮调整特定部位的大小。这样一张合成照片,制作费用仅需约650韩元(约合3.44元人民币)。

“技术进步得如此迅速,着实让我震惊。”作为一名记者,朴高恩两年前就曾撰写过非法数字合成物犯罪的报道。在她的印象里,过去人们还需要付费给专门的技术人员才能制作非法数字合成物,而现在,任何人都可以通过人工智能自行合成。

韩国警察厅发布的“深度伪造犯罪现状”数据显示,深度伪造犯罪案件数量呈现逐年递增趋势。从2021年的156起增加到2022年的160起,2023年达到了180起。2024年前七个月共报告了297起案件—几乎是2021年的两倍。

“guilty archive”是韩国一个公开追踪女性仇视犯罪的社交账号,在社交平台拥有12万粉丝。几天前,运营这一账号的林幼真开始收到网友举报,对方称“电报”上有一个专门针对青少年的深度伪造群聊。

根据对方的提示,林幼真潜入聊天房,看到“充斥着女性裸照的群组,感到非常恶心”。其中令她印象最深刻的是一个专门侮辱某学生的房间,里面有超过1000个成员,他们不仅用该学生的照片制作色情视频,还公开了她的所有个人信息——一些人甚至通过她的联系方式告诉她“你遭受了深度伪造”,以分享她痛苦的反应为乐。

林幼真将这些整理成推文,发在社交平台约一个半小时后,更多的举报信息涌入她的账号。

“平均每分钟会收到8条私信,连凌晨都在不停收到通知。”有人告诉林幼真,大邱针对中学生的深度伪造聊天群已经是第四次出现。她还了解到首尔、水原、大田等地也发现了类似的群组。

从2024年8月27日出现在网络上的“深度伪造受害学校地图”来看,报告遭受深度伪造侵害的初高中及大学几乎分布在韩国的各个地区,尤其是人口和教育资源密集的首都圈和东南部的釜山、蔚山等城市。