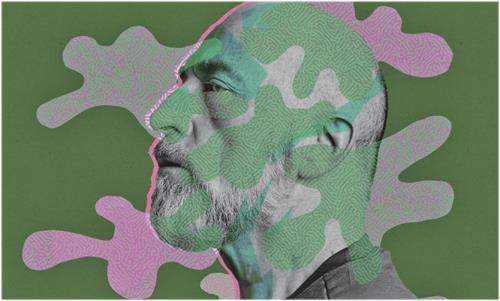

人工智能时代的人类身份验证:区分人类和机器人

随着人工智能(AI)模型越来越擅长模仿人类行为,区分真正的互联网用户和模仿他们的复杂系统变得愈发困难。

真正的问题在于当这些系统被用于传播虚假信息或进行欺诈等恶意目的。这让我们难以信任在网上遇到的内容。

来自OpenAI、微软、美国麻省理工学院和哈佛大学等的32位研究人员组成的团队提出了一个潜在的解决方案——一种名为“人性认证”的验证概念。这些认证可以证明持有者是真实的人,并且不需要获取用户的其他信息。该团队在本月初发布在arXiv预印本服务器上的一篇未经同行评审的论文中探讨了这一想法。

“人性认证”依赖于AI系统仍无法绕过最先进的加密系统,也无法在现实世界中假装成人类。

要获得这种认证,人们需要亲自前往某些机构,如政府或其他受信任的组织,提供如护照或生物识别数据等证明自己是真实人类的证据。一旦获得批准,他们将收到一个可以存储在设备上的单一认证,就像目前可以将信用卡和借记卡存储在智能手机的电子钱包应用中一样。

在网上使用这些认证时, 用户可以将其提供给第三方数字服务提供商, 后者可以使用一种名为零知识证明的加密协议来验证。这将确认持有者拥有“ 人性认证” , 而不会披露任何其他不必要的信息。

过滤掉平台上没有经过验证的用户可能在很多方面都很有用。比如,人们可以拒绝没有“人性认证”的线上交友配对,或者选择不查看任何没有明确由真人发布的社交媒体内容。

登录后获取阅读权限

去登录

本文刊登于《海外星云》2024年10期

龙源期刊网正版版权

更多文章来自

订阅